(原标题:AI全光互联的量产节奏,底层逻辑)

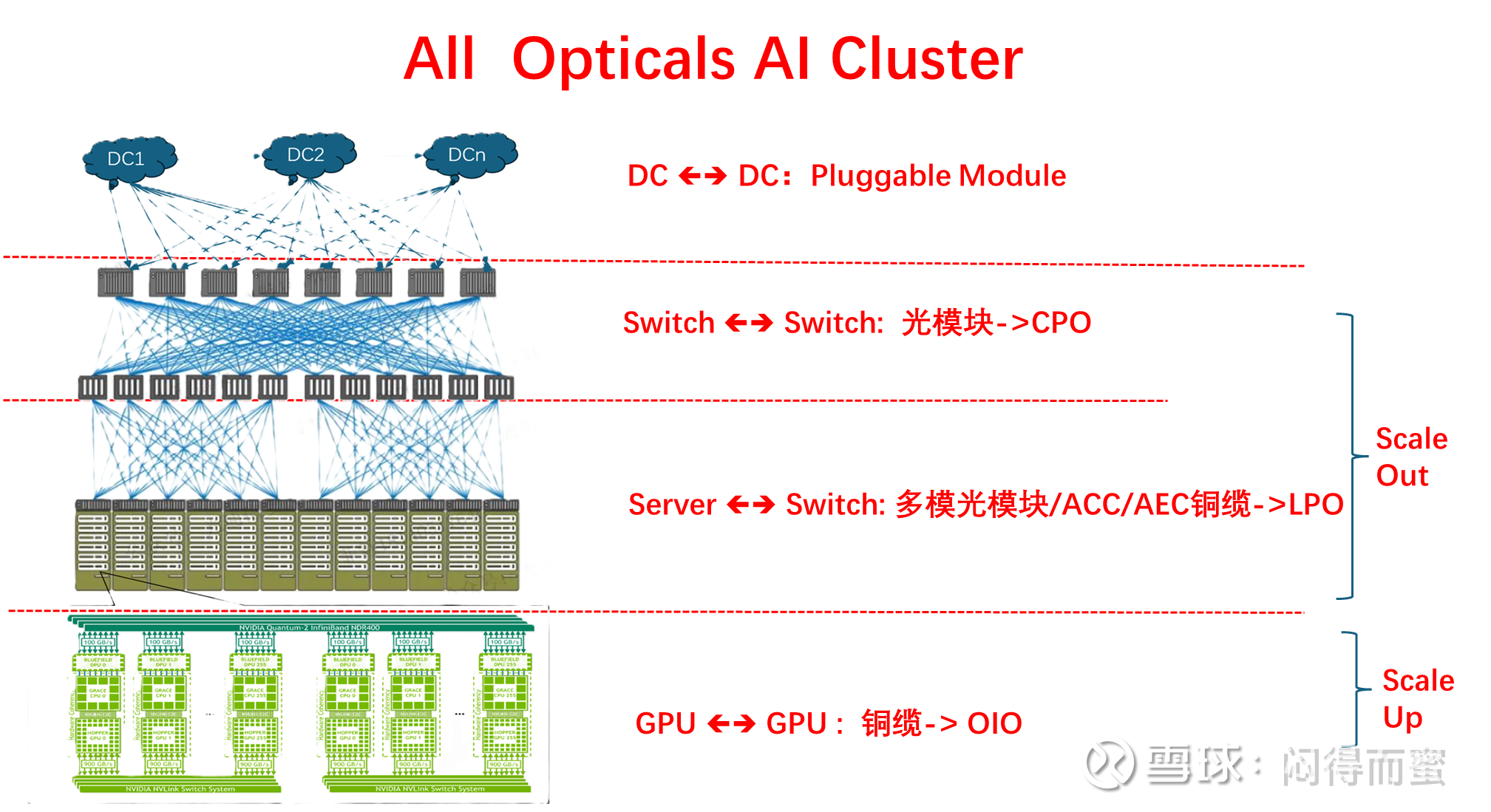

我在一个月前讲阐述了AI全光互联的全景图:

当时我讲了商业化的节奏,遵循硅光模块 -> LPO -> CPO -> OIO 这样的顺序,当时并没有讲背后的Why,后来CPO越吵越热,大家根据各种市场信息做了很多解读,有些太过理想化,有些又太过悲观。今天我说说,全光互联商业化节奏的底层逻辑。

用下面的图,可以概括:

龙头马(AI scaling-law),马车夫(AI算力集成者,比如Nvidia、Broadcom等),两个车轮(产业链 + 生态圈)。

1、scaling-law在牵引整个AI算力硬件的发展,AI算力需求越旺盛,性能要求越高,则CPO、OIO这些新技术导入市场的节奏就会越快。尤其是推理和最近提出来的RL训练,对光互联更紧迫。目前来看,节奏超预期。

2、马车夫方面。随着ASIC代工模式兴起,Broadcom、AMD、Marvell都是Nvidia的强力挑战者,这些光脚的都会争先恐后导入新技术,试图换道超车。最近媒体频繁披露各种新闻,就是这个道理。 目前来看,节奏超预期。

3、产业链的车轮(台积电为首,日月光、Ayar Labs、天孚通信、太辰光…),推广全光互联,他们有巨大的长期利益,加大通过研发攻关和产能建设,把成本、可靠性、产量等问题解决。目前来看,节奏超预期。

4、生态圈的车轮。光模块里面有一个DSP芯片,这个芯片不仅仅解决ASIC与光模块之间链路质量的问题,另外一个作用是,通过大幅度的链路冗余,将光和电两个系统彻底隔离,标准化,从而快速解决不同设备之间的互通难题。大家能看到光模块导入市场的节奏是比较快的。而LPO、CPO呢,则把DSP去掉了,大家只关注了成本和功耗的巨大贡献,却忽视了互通性的困难。DSP free的环境,这是一个全新的生态,只有各就各位,全部都ready,下游的互联网客户才会放心大胆用,才能满足大规模商用的条件。

LPO扮演了重要角色,其可插拔特性兼容存量网络环境,可以快速迭代,如果大家齐心协力,可以迅速将新技术路线的互通性瓶颈打通。从互通的角度看,CPO完全可以继承LPO的成果。可惜的是,目前这些LPO玩家,是未来受损失的企业,利益不一致,他们没有积极性。目前来看,这是CPO量产的主要堵点。

可喜的是,有头部互联网企业,典型如字节跳动因为看好全光互联的优势,主动介入生态圈,通过订单牵引,调动LPO参与者的积极性。

结论:

1、不管是从Scaling law需求侧、马车夫、产业链,都在超预期推进全光互联;

2、主要堵点在互联互通,相关方消极对待,需要下游玩家入场调动积极性;

3、当越来越多的互联网企业将LPO导入AI数据中心,则CPO将会迅速爆发;

4、乐观预期,2025年是LPO互通和上量之年,为2026年CPO上量奠定基础。

$天孚通信(SZ300394)$ $太辰光(SZ300570)$