(原标题:关于AI,现在哪些方向太乐观,哪些方向还可以更坚定一些?)

人工智能的大航海时代

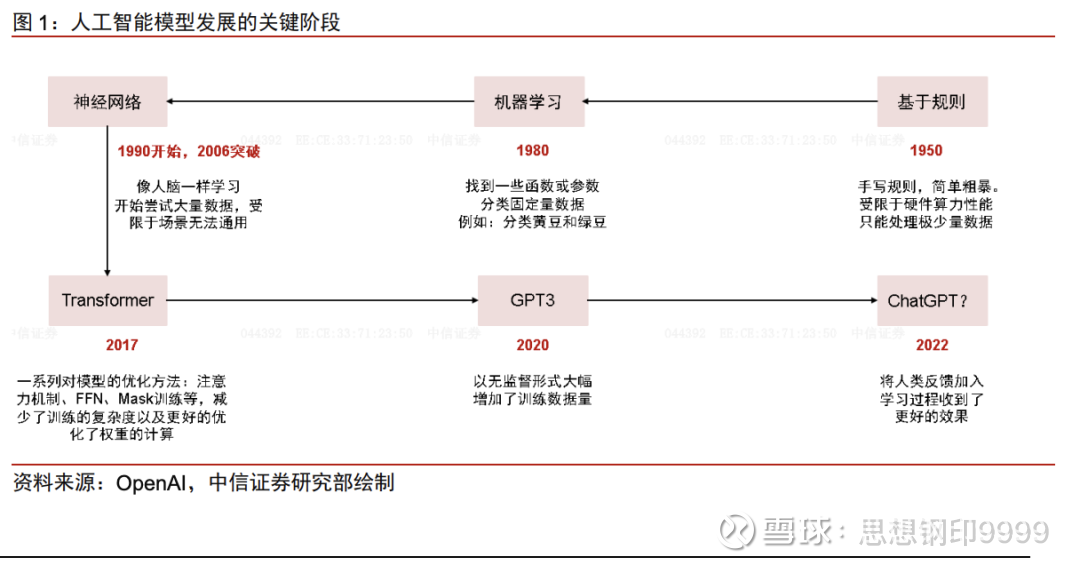

1/6、人工智能不只是ChatGPT

ChatGPT火了之后,有一个段子,说:我们过去想象的人工智能是,我们写诗画画编音乐,AI烧饭洗碗修电脑,没想到,最后是AI写诗画画编音乐,我们自己烧饭洗碗修电脑。

白领危机四伏,蓝领暗自庆幸。

然而,ChatGPT实际上只是人工智能历史上的第一个爆款应用,又是以一对一对话形式展开,效果又超出了我们的心理预期,很容易让我们产生一个“人工智能能说会道”的错觉,进而让我们觉得,它未来可以取代很多白领的工作。

其实,ChatGPT底层的自然语言大模型GPT,只是众多人工智能大模型中率先“涌现”的一个,它更倾向于生成文本的能力,所以看起来都是写写文章,说说话,画画画,但并不是说人工智能就只能干这些,你总不能因为赵本山演小品,就以为东北人只会演小品吧?

所以说,哪有什么“只取代白领的工作”这么简单的事啊,取代蓝领工作的人工智能早晚也会来的。

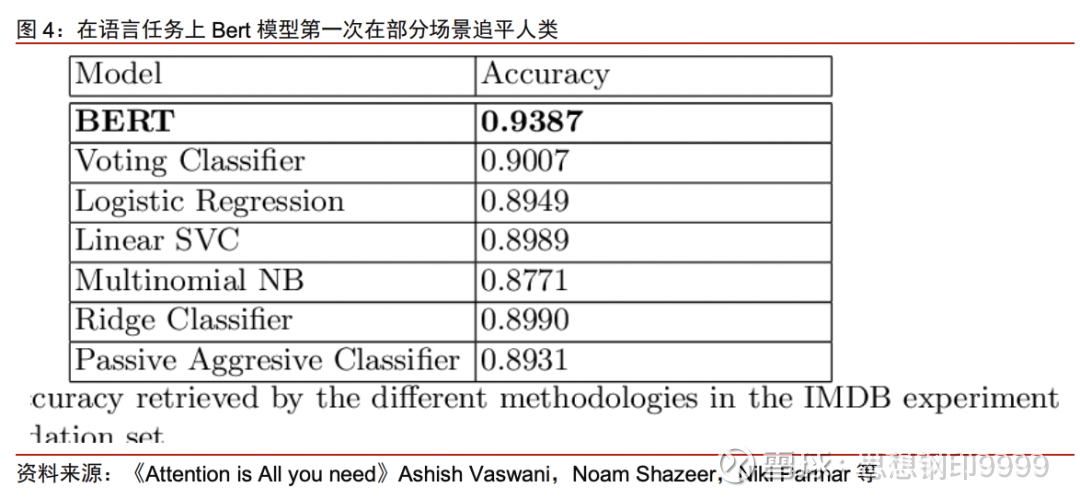

仅就自然语言大模型而言,最有名的有两种方向,除了GPT模型外,还有Google的BERT模型,两者的核心区别在于目标不同,GPT更倾向于生成文本,而BERT 模型更倾向于理解文本。

更不用说还有更多开发中的各种方向的人工智能模型。

本文将从GPT模型与BERT模型的区别出发,分析一系列相关的问题:

1、GPT模型与BERT模型的区别、各种擅长的领域和未来可能适用的场景

2、为什么突破率先出现在GPT模型上

3、AI行情的投资策略、重点方向与风险

2/6、文科的GPT和全科的BERT

说GPT更倾向于生成文本,而BERT 模型更倾向于理解文本,这个区别可能人类无法理解,不理解文本怎么生成文本呢?

但这个问题对AI来说,并不存在。

给一个形象的比喻,有一部励志日本电影《垫底辣妹》,讲一个年级倒数第一的差生通过一年内复习考入庆应大学(日本复旦交大这个级别)的真实故事,相当于在全国学生中的最后2%,进步到前2%。

这个神奇的故事之所以能实现,是因为她只要考“英语、小论文、历史”这三门强调记忆的科目,她不需要很深的理解,只需要记忆和“生成”,注意重点是——不考数学、物理等注重推理的科目。

而GPT模型的成功,就像“垫底辣妹”一样,很大程度在于选择了一个“语言生成”为目标的捷径,从而让它看上去的效果比它实际上的突破更明显——这一点跟现实中一样,一个能说会道的员工,总是比只会干实事的员工,看起来更能干。

Transformer模型有编码器和解码器两部分,GPT模型只使用编码器部分,而BERT模型既包含编码器部分,也包含解码器部分,所以,通常认为,BERT模型需要“理解”文本的内容,GPT模型则不一定。BERT虽然也是一个文科生,但也要学习数学、物理这一类注重推理的课程,全面发展。

两者的区别在一开始训练时就产生了,GPT的训练目标是通过最大化下一个单词的条件概率来预测下一个单词,从而完成生成任务;而BERT的训练目标是随机掩盖一些输入词汇并要求模型预测这些词汇,强迫模型预测缺失的单词,因此产生了双向性。

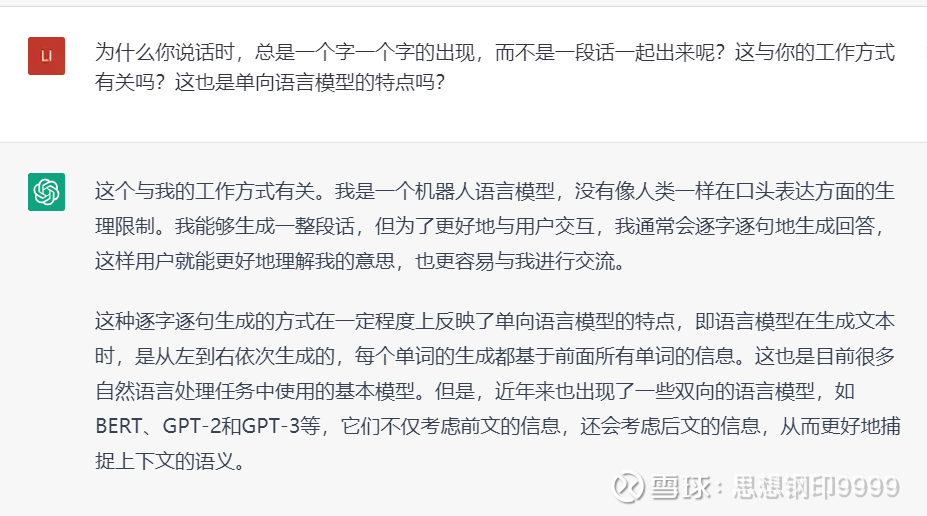

GPT模型完成任务的方法就是“猜猜下一个概率最大的词是什么”,所以ChatGPT都是一个字一个字地蹦出来的,跟刚刚学会说话的小孩子一样。

但BERT模型就不同了,它会考虑每一个单词与前后文的关系,如果未来能成功训练出来(注意这个前提),所有的文字应该是一起出来,它会把所有的话想好了,再一口气输出。

很明显,BERT 模型的训练要求更高,实现难度更大,这就是为什么Google在人工智能的研究方面此前一直遥遥领先,会忽然间被积累不如它的微软超越。

虽然大家已经觉得GPT很神奇了,但如果真的大规模投入应用,在那些非生成内容为主的应用上,它还是有缺陷的。

比如你对AI助理说:“帮我在陆家嘴附近订一个粤菜餐馆,人均消费在500元左右,时间是明天晚上。”

对于这个句子,GPT模型的“理解”是从过去的语料训练中,判断“陆家嘴、粤菜、明天晚上、人均消费、500元”这些词的组合而不是词本身的意义,由此来判断自己应该输出什么样的内容,它对于语言的最小理解单位是句子,而不是词汇,会导致“模型产生幻觉,编造训练中从未有过的数据”。所以我们有时看到GPT推荐必胜客等成都小吃的离谱结果,因为它并不理解“必胜客”的属性,它还会把数学计算中的1995当成年代。

虽然GPT4中,这些现象已经大大减少,但由于底层逻辑仍然是一个“文科生”,未来很难说在遇到更复杂的问题时,会不会出错,很可能最后给你预订了一个经常与粤菜馆一起出现的咖啡馆。

而BERT模型的最小理解单位就可以到词汇级别,主要是因为模型在训练中,强化了对实名词汇的判断,即槽位填充(Slot Filling)。槽位表示文本中的特定信息或实体,例如日期、时间、地点、人名等,这些都是理解一段话的关键信息,需要从文本中识别并填充预定义的槽位或信息。

通过训练,它首先可以从这些词汇的属性,来判断句子的类型是美食类,还是体育、政治、科技、娱乐(文本分类并不是GPT的训练项),经过此项训练,BERT模型可以理解到词汇这个级别,可以判断“陆家嘴、粤菜、明天晚上、人均消费、500元”这些词的意义,从而给出更准确的推荐,以及下一步预订的动作,而GPT的理解就不一定准确了。

由此看来,GPT模式不会是终点,AI代替人类的工作,文本类只是一个“开胃菜”。

可能有人会想,为什么Google不先做一个相对容易的文本生成模型,而要先做一个更难的呢?

3/6、模型的未来应用

原因很简单,BERT模型未来的用途可能更广阔。

GPT模型就像文科毕业生,由于其在生成文本方面的强大能力,毕业后最大的“就业去向”是自动生成文章类的“工作”、包括新闻、广告文案、创意内容、法律文书、文秘、各类咨询,等等;其次的“就业去向”是作为聊天机器人、虚拟助手、智能客服,等等,进行更加自然、流利的对话。

而BERT模型并不会局限在“文科领域”,它可以凭借自己执行文本分类、命名实体识别、关系抽取等任务的能力,有更广泛的用途,比如可以用于帮助搜索引擎更准确地理解用户查询意图,从而提供更精准的搜索结果——这就是Google和百度一直在重点开发这个方向的原因。

更重要的是,BERT模型可以从非结构化的日常语言数据中,抽取结构化数据,就是我们前面说的订餐馆的例子,小到要求助理召集一场特定人员参加的有特定目的的会议,大到智能驾驶——

我问过ChatGPT一个问题:“你觉得智能驾驶更有可能通过哪一个模型实现?”

它很坦诚地承认,BERT模型可能更适合在复杂的驾驶场景中进行深度理解和决策,理由是:

“在智能驾驶中,理解交通标志、识别道路标线、理解交叉口的交通信号等,都需要对文本信息进行深入的理解和推断。BERT模型作为一种能够对文本信息进行深度理解的模型,可能在智能驾驶中具有更广泛的应用潜力。”

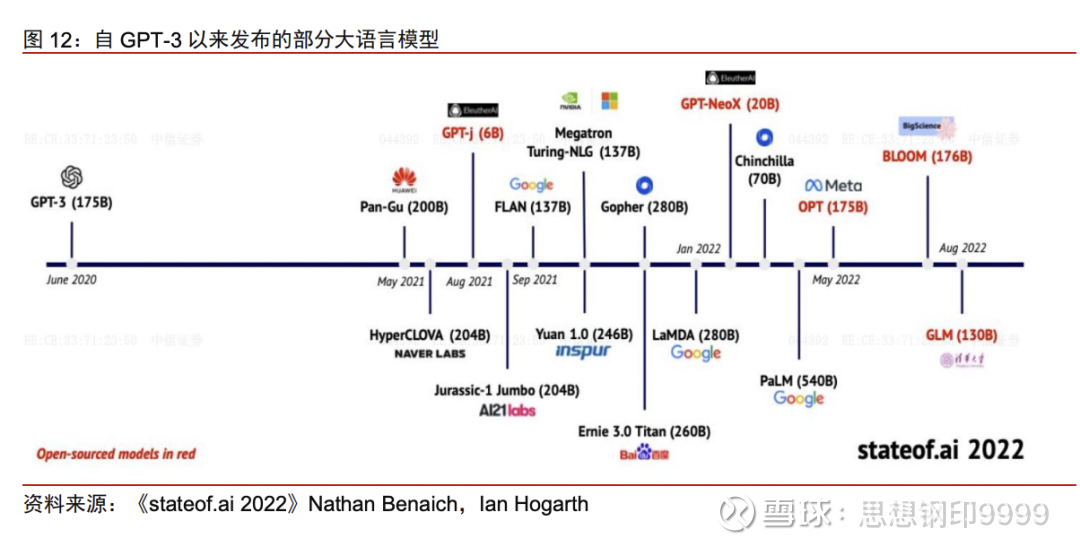

然而,双向语言模型训练难度太大了,效果一般,导致众多企业在这方面的投入更犹豫,转机出现在OpenAI在GPT这个单向语言模型上的持续投入,最终出现了GPT-3.5的质的突破,实现人工智能从猿到人的关键进化。

而且,未来即使BERT这一类双向语言模型也实现了“涌现”,因为它的计算复杂度较高,算力成本也就更高,很可能从成本上限制了它的使用场景。

所以未来不会有大一统的模型,可能会是各种模型的融合,在实际应用中需要根据任务需求和计算资源进行选择,以充分发挥各自的优势。

例如,一个智能客服对话系统,其工作内容可以分成两类,一类是咨询,只需要简单判断客户的意图,主要任务是生成内容,客户也没有很高的精度要求,用GPT这一类单向模型就够了;

另一类客户沟通类工作,比如消费者要求退换货、赔偿、投诉等涉及复杂判断和反复沟通的需求,对理解能力要求很高,还要判断客户提供信息的真实性,甚至需要AI判断客户此时的情感类型和程度,就需要用BERT模型进行意图识别和槽位填充,从而实现更加智能、灵活的对话交互。

对比了GPT和BERT的区别,可以看出,GPT并不像大家想象的那么万能,它的训练目标中,对判断推理的要求没有文本生成高,下游应用可能并不会那么多。

那么,这个题材现在是不是有点炒作过了呢?会不会像21年的元宇宙一样雷声大雨点小呢?

4/6、AI行情的投资策略

答案是“不会”,GPT模型的意义不在于“找到东方的黄金”,而是“发现新航线”。

人工智能的理论突破,基于Transformer架构的自然语言处理模型,实际上是发生在前几年,只是之前没有人能实现它,所以并不确定它行不行,加上费用都是以亿为单位,就算是巨头,在投入上都比较小心。

所以ChatGPT的重要意义在于形成了一个行业共识——只要基于海量的数据去喂这个模型,时间到了,就能“大力出奇迹”,最终实现超大神经网络能力的涌现。

国内的AI大模型长期发展缓慢,但ChatGPT问世后,短短几个月一下子冒出了多个能力相当于GPT-3的大模型,并不是这些巨头在蹭热点,而是新航线被确认了,必然会有多支“舰队”出发,之后也必然会出现更多的不同于GPT的“新航线”。

当然,越是星辰大海级别的投资机会,越需要合理的投资策略。

以应用方向为例,对应的行业都是传媒影视游戏、各种互联网应用和软件,这一类行业之前因为商业模式的缺陷,估值普遍不高,所以AI应用行情的核心逻辑是用AI改造传统的商业模式,出现业绩与估值的戴维斯双击。

但行情是一波波走出来的,这一类产业大趋势的行情通常包括三个阶段:

第一阶段:位置驱动和故事驱动

第二阶段:逻辑驱动和业务驱动

第三阶段:业绩驱动和商业模式驱动

第一阶段的核心原因是“估值低、机构持仓低、预期低”的“三低”,以AI应用为名义的估值修复行情。既然是估值修复,那就是“逻辑第三、故事第二、位置第一”,大部分公司不分好坏,只要有诉求,都能上涨。

可一旦估值修复完成,第一批信仰者已经满仓,其他人还在观望,市场冷静下来,行情就要进入到逻辑驱动和业务驱动的第二阶段。

这个阶段,AI应用标的的投资方向,主要考虑业务是否成立,要考虑AI使用成本与客户需求的匹配度,尽可能优先考虑GPT3.5和4非常擅长的功能,其次是支持的功能,对年底可能推出的多模态的GPT5,还是要多一份谨慎。

我前面分析了一堆GPT模型的特点,正是为了从这个特点出发,分析现有的投资炒作逻辑中,哪些逻辑后面可能被证实,哪些逻辑可能被证伪。

5/6、AI应用重点投资方向

一、文字输出、图像输出类应用仍然是最需要关注的方向

人工智能首先在语言和图像输出方面实现质的飞跃,等于方向已经指明,这将鼓励各大平台加大在此方向上的投入。

首先是办公应用,其次是游戏,再次是部分偏内容服务的广告营销、咨询服务和法律服务等企业培训服务,以及少数影视传媒。

变好的不但有业务,还有商业模式。内容生成行业的成本项,从没有规模效应、难以控制的人,变成有规模效应、控制性很好的AI,市值空间变大,理应获得更高的估值。

但这里需要区别内容生成和创意生成,前者是指大量重复的、受众低要求的创作,后者是少数内容精英的创作成果,观众要求高。以影视为例,仅依赖广告、观众 不太挑剔的免费电视剧更偏向于前者,而电影、付费精品剧更偏向于后者。

AI对创意生成的替代作用非常小,创意行业的商业模式不会因此改变,仍然是没有什么投资价值的行业。

二、侧重于推理判断和有后续动作的应用,要具体应用具体分析

前面我以客服机器人为例,分析了客服中两种不同需求对AI的挑战不同,客户的预期不同,最终导致AI的效果与付费意愿也就不同,所以,需求中侧重于推理判断和有后续动作的应用,要具体应用具体分析,总体上有几个原则:

1、需求有明确结果,但对结果要求高的应用要谨慎,比如AI智能驾驶和AI辅助诊断,有人认为AI只是辅助诊断,但他们一定忘了魏则西的悲剧,AI诊断的暗示性远远强于搜索结果;

2、可以直接低成本带来新客户的(游戏、图片创作、法律心理管理等咨询服务、部分黑产),最佳;可以提高付费意愿和单价的(办公应用),其次;只能省成本或只能改善用户体验的(企业文书、网文创作、药物研发),再次;价值感不明确导致付费比较犹豫的(目前大部分),最差;

3、效果可能一般,但非常刚需或者价值感很强(比如金融、教育);付费方与使用方分离的(礼品类硬件应用);

4、入口强制使用的(国民级APP、留存社交关系的App、手机电视电脑智能音箱等);

5、目前大量被炒作的应用方向(订餐、旅游、购物),大多虽理论上可以提升用户体验,但并不能带来明确的核心价值,或者不解决用户痛点,而且结果也并不一定准确。这一类应用,可能用了很高的成本只创造了少量新需求和新收费,最终得不偿失。

三、正确的方向和模糊的个股

虽然像游戏、办公、金融、教育,都是前期炒得比较多的方向,但这些方向都非常确定,需要有一级市场的前瞻性思维,并不需要看到业绩的落地。最怕的是一开始不信,看到业绩落地后又相信了,业绩落地、确定性很高时,估值可能已经非常离谱了。

也不要因为用过之后体验不好,就觉得这个项目不行,只要方向正确,人工智能的进化速度远远超过人类的想象。

最大的风险是方向确定,但标的不确定,最好的办法就是打包买,看好办公,就多找几个方向的相关标的,主做中国市场的,覆盖全球市场的,A股的、美港股的,通通打包买。

更多关于人工智能的观点和分析,可以看看同名 XX号(思想钢印),欢迎交流。

6/6、大模型的商业价值存疑

从ChatGPT的输出内容看,它有明显的意识形态,这是在训练中有目的输入的,这肯定会给各国政府一个启发——利用人工智能训练进行全民价值观的灌输或潜移默化。

至少在我国,大语言模型将兼具“宣传阵地”(推理)和“教育阵地”(训练)的作用,未来主要方向不是商业化,而是像现在的媒体和教育机构一样被高度管控,以防止出现互联网时代BAT那样过于强势的非官方控制的巨型平台。

所以大模型的商业价值有相当的不确定性。正在做大模型的公司,如果能先于监管“把孩子生下来”,算是安全上岸,日后无非是监管成本问题。难的是开发进度落后的,很可能最后胎死腹中,投资打水漂。

回到前面对GPT模型定位的分析,大语言模型必然将遇到这个问题,言语就像氧气、水源、粮食一样,商业化必然面对各种政治的、道德的挑战,可能商业价值更大的,还是侧重推理的非语言类大模型,以及在语言大模型基础上训练的专业模型。

关于科技股产业趋势投资的方法,推荐看我的下列相关文章:

“从0到1”和“从1到N”:科技股投资的产业趋势(14000字直播整理版加PPT)